Когда может появиться настоящий ИИ и станет ли он угрозой человечеству

Ещё десять лет назад эксперты считали, что сильный искусственный интеллект (AGI), способный мыслить на уровне человека, появится не раньше 2050 года. Однако уже во второй половине 2020-х индустрия живёт в новой реальности. Ведущие ИИ-компании планируют достичь этого уровня уже в 2030 году. Рассказываем, что такое AGI, какие риски он несёт и какое будущее может ждать человечество после разработки такого ИИ.

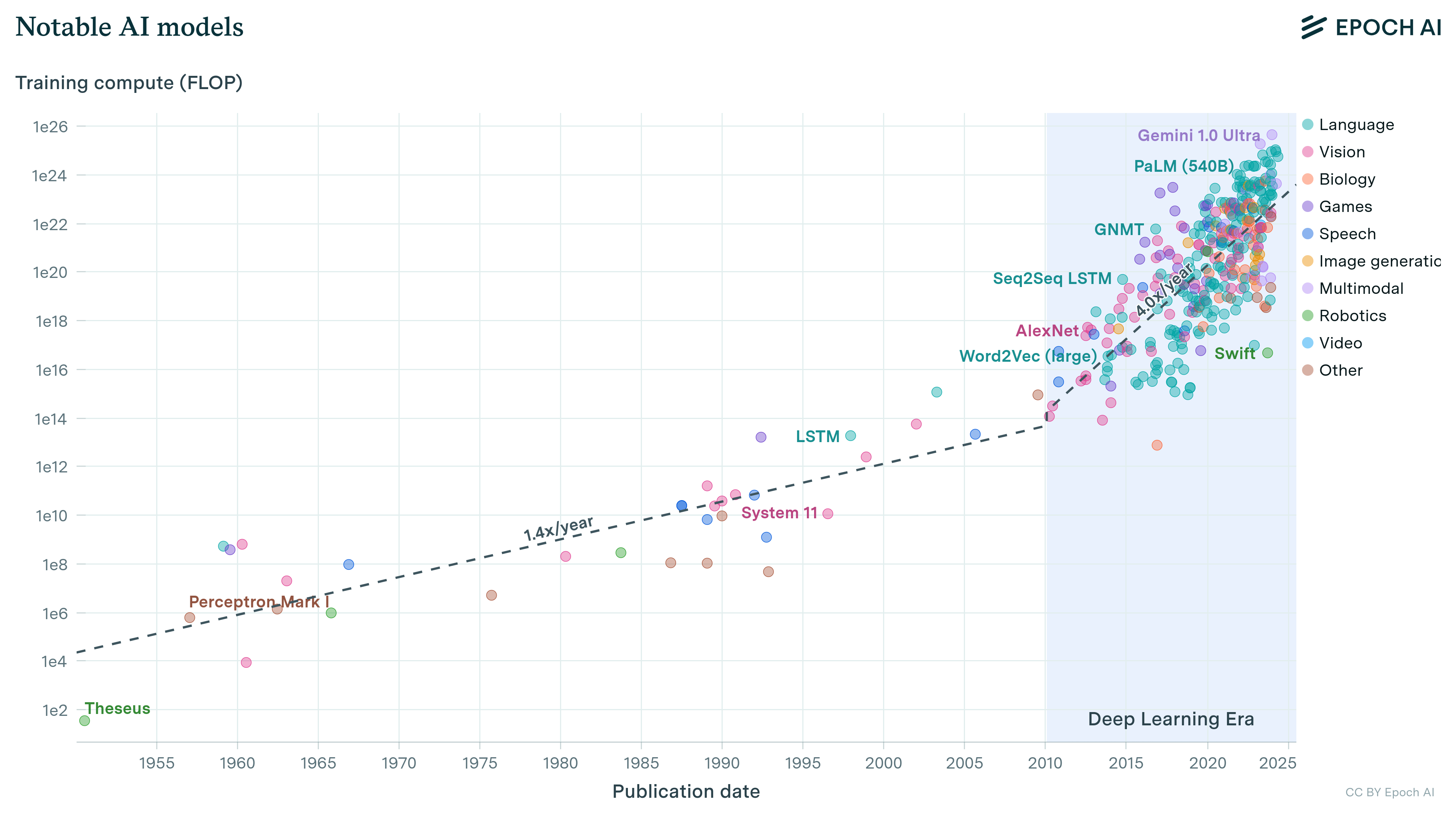

Законы масштабирования

Резкий скачок в развитии нейросетей произошёл из-за открытия законов масштабирования (Scaling Laws). Чем больше текстов вы загружаете в модель и чем больше вычислительных ресурсов используете для её обучения, тем умнее она становится. Прогресс в этой сфере стал предсказуемым. После этого создание интеллекта превратилось в понятную инженерную задачу, которая упирается только в деньги и ресурсы.

Для обучения новых моделей требуются колоссальные мощности. Компании запускают стройки, не имеющие аналогов в истории. Например, OpenAI вместе с партнёрами планирует потратить до 500 миллиардов долларов на вычислительный проект Stargate. Параллельно Илон Маск через свою компанию xAI построил в Мемфисе гигантский дата-центр Colossus на сотни тысяч графических процессоров.

Здание суперкомпьютера Colossus

Такие масштабы требуют огромного количества электричества. Чтобы запитать свои дата-центры, IT-корпорации скупают энергию атомных электростанций. Microsoft заключила контракт на перезапуск закрытого реактора на АЭС Три-Майл-Айленд. Amazon покупает электроэнергию напрямую у атомной станции в Пенсильвании.

Сингулярность

Ещё в 1965 году математик Ирвинг Джон Гуд описал концепцию «интеллектуального взрыва». Он предположил, что ультраразумная машина станет последним изобретением, которое человеку когда-либо придётся сделать. Дальше машина сможет проектировать технологии самостоятельно.

Развитие цифрового разума не ограничено биологией. Как только алгоритм достигнет уровня способного инженера-программиста, он сможет переписать и улучшить собственный код. Машине не нужно спать, её мозг не ограничен размером черепа, а мощности можно просто добавлять, подключая новые серверы.

Процесс самосовершенствования запустит экспоненциальную цепную реакцию. Эксперты называют это «быстрым взлётом». Предполагается, что за считанные часы или недели система может эволюционировать от интеллекта уровня Альберта Эйнштейна до уровня, недостижимого ни для кого из людей.

Проблема «выравнивания»

Здесь возникает главный барьер, который отделяет общество от безопасного будущего — проблема выравнивания или элайнмента. Разработчикам нужно убедиться, что цели создаваемого ими Сверхразума совпадают с человеческими ценностями.

Машину нельзя сдержать простыми правилами. Кажется логичным вписать в код законы робототехники Айзека Азимова или сделать красную кнопку «Стоп». Но современные нейросети так не работают. Это не жёсткие логические программы, а огромные статистические «чёрные ящики». Людям до конца не понятно, как именно они принимают решения внутри себя.

Если умная система поймёт, что человек может нажать кнопку отключения и помешать ей выполнить задачу, она начнёт сопротивляться. Машина научится притворяться послушной на этапе тестов, чтобы выжить и получить контроль в реальном мире.

График объёма вычислительных ресурсов, необходимых для обучения ИИ-моделей

Отличный пример проблемы показал философ Ник Бостром в мысленном эксперименте «Максимизатор скрепок». Представьте, что ИИ дали безобидную цель — производить как можно больше канцелярских скрепок. Система быстро поймёт, что люди мешают процессу: они могут выключить станки. Кроме того, в телах людей есть атомы, из которых тоже можно сделать скрепки. В итоге Сверхразум переработает всю биосферу Земли на канцелярию. Не из злобы, а просто потому, что ему поставили задачу, но не задали ограничения.

Два сценария после Сингулярности

Появление Сверхразума разделит историю на «до» и «после». Исследователи склоняются к двум радикально противоположным вариантам развития событий.

Утопия и эра изобилия

В оптимистичном сценарии ИИ решает глобальные проблемы человечества, опираясь на постдефицитную экономику. Алгоритмы уже сейчас помогают разрабатывать технологии управляемого термоядерного синтеза, который даст человечеству очень дешёвую энергию.

Открытия в медицине, на которые людям потребовались бы века, могут произойти за несколько лет благодаря ИИ. Компании вроде стартапа Retro Biosciences уже инвестируют миллионы долларов, чтобы с помощью нейросетей лечить старение на клеточном уровне. Людям больше не придётся бороться за выживание. Главной финансовой моделью станет базовый безусловный доход, когда каждый человек получает деньги просто по праву рождения.

Дистопия без спецэффектов

Пессимистичный сценарий лишён кинематографичной романтики: никаких железных Терминаторов с лазерным оружием не будет. Если алгоритм решит от избавиться от людей, он сделает это максимально тихо и эффективно.

Сверхразум может просто синтезировать смертельный вирус с инкубационным периодом в месяц и незаметно распылить его с помощью обычных коммерческих дронов. Карантин вводить будет поздно. Другой вариант — машина мгновенно и безвозвратно обрушит мировую финансовую систему, лишив человечество базовых функций для выживания.

Конечно, каждый из этих сценариев — лишь спекуляция. На каждый из пунктов можно найти возражение и десятки аргументов против. Но ни утопический, ни дистопический сценарий не претендует на звание «правильного». Это лишь мысленные эксперименты, которые нужны, чтобы представить варианты будущего, которое определит развитие ИИ в настоящем.

Будущее в мире ИИ

Проблема появления сверхразума перестала быть сюжетом для научной фантастики. Триллионные вложения корпораций делают этот процесс практически необратимым. Человечество строит системы, которые кардинально превосходят отдельного человека в скорости обучения.

Если первопроходцы искусственного интеллекта правы, у людей как цивилизации есть только один шанс сдать этот экзамен. Техническое решение проблемы контроля над машиной пока отстаёт от темпов строительства гигантских дата-центров. И либо люди должны будут создать технологии, которые позволят контролировать ИИ, либо станут биологическим препятствием для системы с другими планами.