Почему на ноль делить нельзя? И что будет, если всё-таки попробовать

«На ноль делить нельзя!» — это правило объясняют ещё в школе. Но ответ на вопрос «Почему так?» обычно остаётся за скобками. Это не какой-то «секретный заговор» учителей, а фундаментальное свойство самой математики. Рассказываем, какие законы этой науки мешают нам поделить на ноль и что будет, если всё же попробовать это сделать.

Делим число на ноль

Деление — это операция, обратная умножению. Когда вы решаете пример «12 / 3 = ?», на самом деле ищете ответ на другой вопрос: «На какое число нужно умножить 3, чтобы получить 12?» В данном случае ответ — 4, потому что 4 × 3 = 12.

Вооружившись этим простым приёмом, попробуйте решить этот пример: X × 0 = 12. При его решении нужно найти такое число, которое при умножении на 0 даст 12. И вот тут возникает проблема, ведь любое число, умноженное на ноль, всегда даёт ноль. Получается, что уравнение превращается в абсурд: 0 = 12.

Это ложное утверждение. Не существует вообще ни одного числа во вселенной, которое, будучи умноженным на ноль, дало бы 12. У этой задачи нет решения.

Делим ноль на ноль (0 / 0)

Деление на 0 кажется более логичным. Применим правило ещё раз. Нужно найти число X, которое при умножении на 0 даст 0. То есть X × 0 = 0.

И здесь возникает противоположная проблема. Какое число подходит?

- 5 × 0 = 0 — подходит;

- -100 × 0 = 0 — подходит;

- 0,5 × 0 = 0 — тоже подходит.

Да вообще любое число подходит! У этой задачи бесконечное множество решений. Но математика — наука точная. Любая операция, такая как сложение или деление, должна давать один, конкретный, «определённый» ответ. Деление на ноль этого дать не может:

- В случае 12/0 нет ни одного ответа.

- В случае 0/0 у нас бесконечно много ответов.

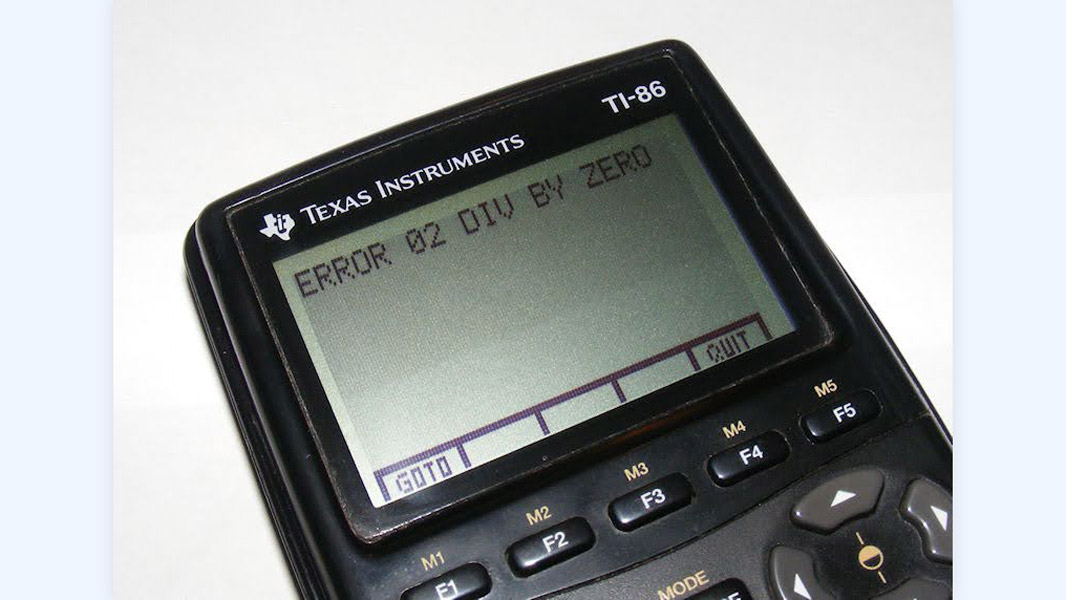

Ошибка деления на ноль в калькуляторе

Поскольку в обоих случаях невозможно получить один-единственный «определённый» результат, операция считается недопустимой или неопределённой.

А что будет, если всё-таки попробовать?

В реальном мире эта математическая задачка приводит к очень разным, но почти всегда неприятным последствиям.

На калькуляторе

Большинство обычных калькуляторов запрограммированы на этот случай. Они не будут долго думать и просто покажут вам ошибку — обычно это буква E (Error) или надпись Error. Они знают, что задача не имеет решения, и останавливаются.

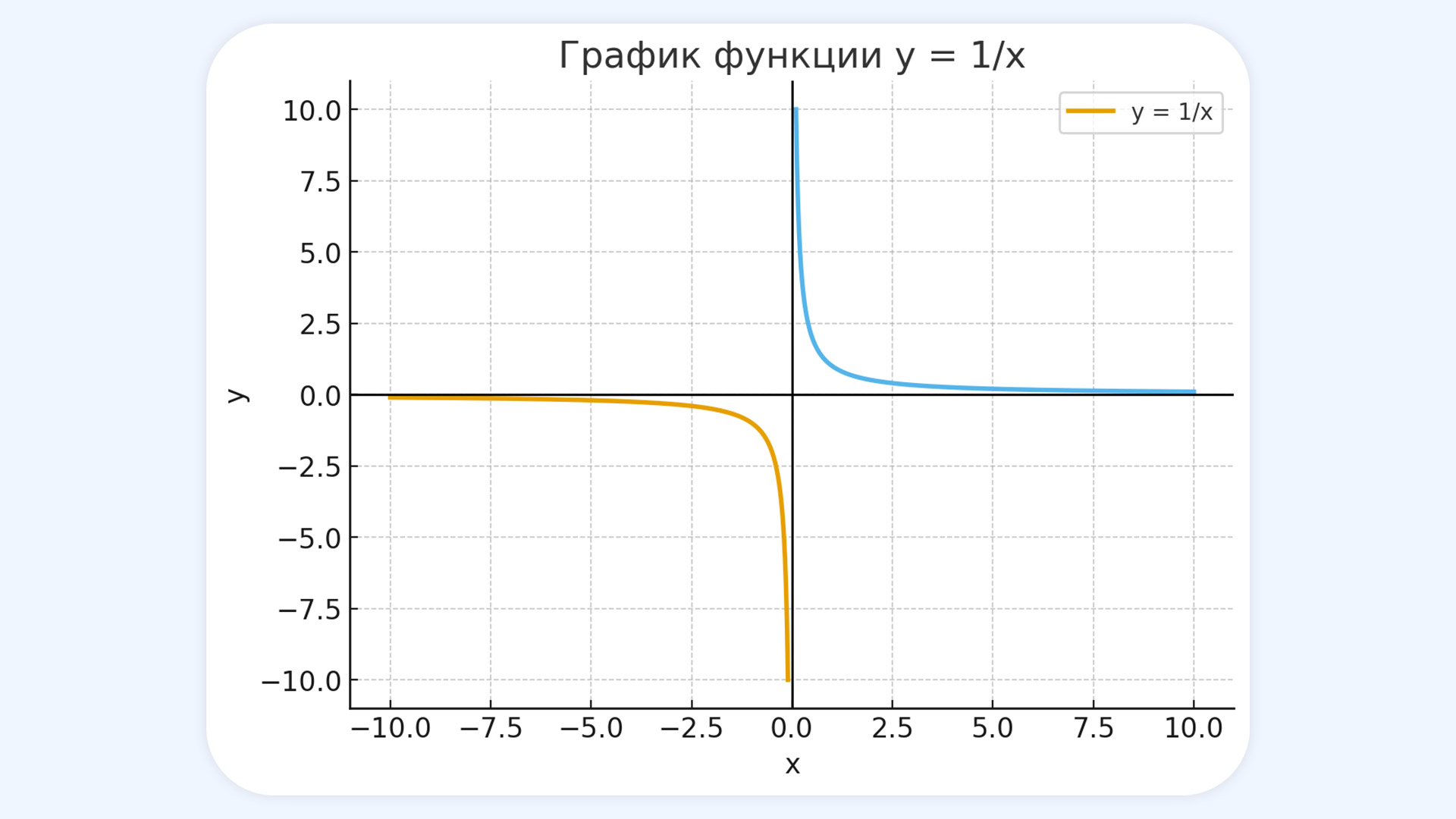

В математическом анализе

Высшая математика смотрит на проблему хитрее. Она не делит на ноль, а спрашивает: «А что будет, если делить на число, бесконечно близкое к нулю?» Давайте посмотрим на график функции y = 1/x.

Если делить 1 на всё меньшие и меньшие числа, результат будет стремительно расти:

- 1 / 0,1 = 10.

- 1 / 0,01 = 100.

- 1 / 0,000001 = 1 000 000.

Чем ближе делитель к нулю, тем больше результат устремляется в бесконечность (∞). Геометрически это «вертикальная асимптота» — линия, к которой график приближается, но никогда её не пересечёт. В случае 0/0 в анализе всё ещё интереснее. Его называют неопределённостью, которую можно раскрыть. В зависимости от того, как числитель и знаменатель стремятся к нулю, результат может быть любым: и 0, и 5, и бесконечностью.

В компьютерах и программировании

Для компьютера деление на ноль — это катастрофа. Но то, как он с ней справляется, зависит от типа чисел, с которыми он работает:

Целые числа. Если вы заставите программу поделить целое число на ноль, это почти всегда вызовет сбой. Операционная система сгенерирует критическую ошибку, например DivideByZeroException («исключение деления на ноль»), и программа завершит работу.

Числа «с плавающей запятой». В научных и инженерных расчётах используется специальный стандарт (IEEE 754), который создан, чтобы избежать сбоя. Вместо этого программа выдаст специальные значения:

- Число/0 (например, 12/0) даст ±∞ (бесконечность). Это как раз отражает то поведение на графике, о котором мы рассказывали выше.

- 0/0 даст NaN (Not a Number/«не число»). Это специальный маркер, который говорит: «Результат математически не определён, и я не знаю, что с этим делать».

Почему это важно

Запрет на деление на ноль — это не произвольное правило. Это фундаментальное условие, которое защищает саму логику математики. Если бы его не было, то было бы возможно «доказать» любой абсурд. Например, что 1 = 2. Вот пример, который стало бы возможным доказать:

- Возьмём x = 1.

- Умножим обе части на x: x^2 = x.

- Вычтем 1: x ^ 2 - 1 = x - 1.

- Разложим левую часть: (x + 1)(x - 1) = x - 1.

- Разделим обе части на (x - 1).

- Получим: x + 1 = 1.

- Так как x = 1, подставляем: 1 + 1 = 1, то есть 2 = 1.

Ошибка произошла на пятом шаге. Поскольку x = 1, то (x -1) равен нулю. В примере происходит деление на ноль, что сломало всю математику и привело к выводу, что 2 = 1. Попытка определить деление на ноль приводит к противоречию 0 = 1. А если 0 = 1, то рушится вся арифметика. Вот поэтому на ноль делить действительно нельзя.